blog

Avian löst langsame KI-Inferenz durch eine private Plattform für Open-Source-Modelle. Ergebnis: 3–10x schnellere, sichere API mit Weltrekord-Performance ohne Datenspeicherung.

AI Models & Foundations, Revenue Operations & Forecasting

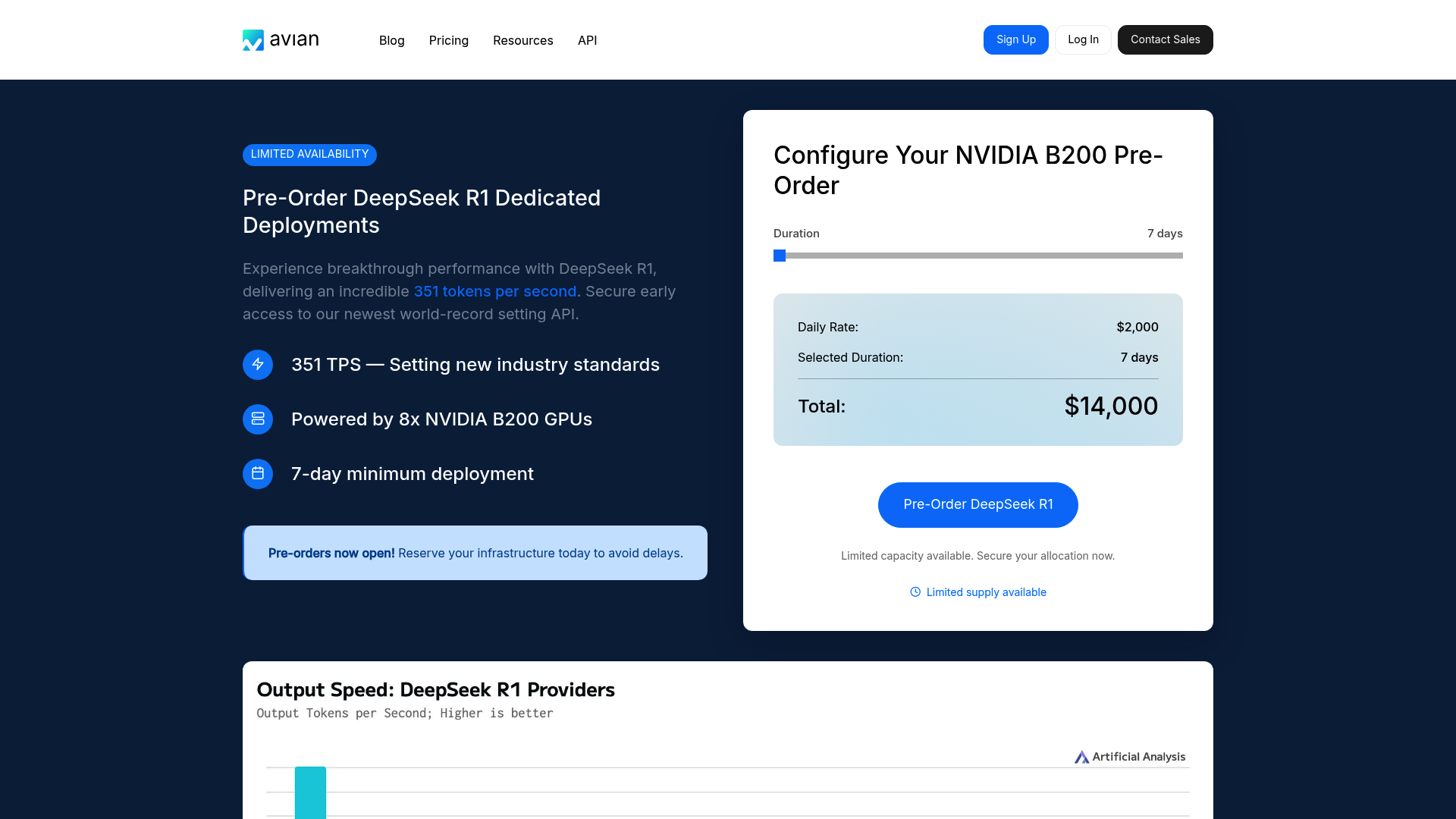

Avian positioniert sich 2026 als führendes KI-Forschungslabor für Unternehmen, die maximale Geschwindigkeit ohne Kompromisse beim Datenschutz suchen. Mit einer Inferenzrate von 351 Token pro Sekunde für DeepSeek R1 setzt Avian neue Maßstäbe. Die Lösung ist ideal für Firmen, die Open-Source-Modelle in einer sicheren, SOC-2-konformen Azure-Umgebung betreiben möchten, wobei die Kosten für dedizierte Hardware primär auf Enterprise-Budgets zugeschnitten sind.

Das Herzstück von Avian ist die Optimierung für NVIDIA Blackwell B200 GPUs. Durch den Einsatz von TensorRT-LLM erreicht die Plattform Geschwindigkeiten, die 3- bis 10-mal schneller sind als der Branchendurchschnitt. Dies ermöglicht nahezu verzögerungsfreie Interaktionen, selbst bei komplexen Modellen wie DeepSeek R1.

Im Gegensatz zu öffentlichen API-Anbietern garantiert Avian, dass keine Daten dauerhaft gespeichert werden. Die Infrastruktur ist SOC-2 zertifiziert und vollständig konform mit DSGVO (GDPR) und CCPA. Ein spezieller Privacy-Modus für Chats sorgt für zusätzliche Sicherheit in regulierten Branchen.

Die Integration ist denkbar einfach, da Avian eine voll kompatible Schnittstelle zum OpenAI-Standard bietet. Bestehende Workflows können innerhalb von einer Minute auf Avian umgestellt werden, um von der höheren Geschwindigkeit und dem privaten Hosting zu profitieren.

Avian verfolgt ein zweigleisiges Preismodell, das sich an professionelle Anwender richtet:

Im Vergleich zu Wettbewerbern wie Standard-Cloud-Providern bietet Avian durch die spezialisierte Optimierung ein besseres Preis-Leistungs-Verhältnis pro generiertem Token, erfordert jedoch durch die Mindestlaufzeiten bei dedizierter Hardware ein höheres Initialbudget.

Besonderes Merkmal Bewertung & Kritik Ideal für Rekordverdächtige Inferenz (351 TPS) Hervorragende Geschwindigkeit, jedoch hohe Kosten pro GPU-Stunde. Unternehmen mit Fokus auf Latenz und Datenschutz.

Avian.io positioniert sich im Jahr 2026 als führender Anbieter für private KI-Inferenz. Mit einer Geschwindigkeit von 351 Token pro Sekunde für DeepSeek R1 auf NVIDIA B200 Hardware setzt das Unternehmen neue Maßstäbe. Es bietet eine SOC-2-konforme, private Umgebung für Open-Source-Modelle, was es zur ersten Wahl für datenschutzbewusste Großunternehmen macht, die unabhängig von OpenAI agieren wollen.

Durch die Nutzung der NVIDIA Blackwell B200 Architektur erreicht Avian Inferenzgeschwindigkeiten, die 3-10x schneller sind als Standard-Cloud-Anbieter. Besonders die Optimierung für DeepSeek R1 wird hervorgehoben.

Avian bietet vollständige SOC-2, GDPR und CCPA Konformität. Modelle werden in isolierten Umgebungen gehostet, sodass Firmendaten niemals zum Training verwendet werden.

Im Vergleich zu Anbietern wie Replicate oder Hugging Face Inference Endpoints bietet Avian höhere Geschwindigkeiten durch dedizierte B200-Hardware, verlangt dafür jedoch einen Premium-Preis. Während Lambda Labs günstiger sein kann, bietet Avian die bessere schlüsselfertige Enterprise-Infrastruktur.